זעם נגד תרגום המכונה 📻 האחראי על האינטרנט בגלצ

🎧 ארכיון “האחראי על האינטרנט” בכל הפלטפורמות 🔊

תרגום מכונה של בינה מלאכותית הוא כלי שימושי עם פוטנציאל נזק – דחיית בקשת מקלט של פליט, מעצרי שווא, טעויות רפואיות ועלבון לא-מכוון שהוביל לרצח

מעשי ידיי טובעים בפייק

כתב חדשות 12 מתן יעקב דיווח ב”מהדורת שלוש עם עופר חדד” מה-23.04.2023 על הצפת חניון מכוניות יוקרה בפלורידה בגלל גשם, והציג סרטון שבו נראות המכוניות מכוסות עד מחציתן במים. המתגלץ’ דודי עידו מור גילה שלא היתה הצפה, וכי הסרטון המפוברק נוצר באמצעות הפילטר LIDAR AR.

סרטון החניון המוצף (קודזמן 48:30):

הפוסט של דודי עידו מור:

עוד בנושא: מדוע בחדשות 12 שידרו בטעות סרטון מזויף שמצאו באינטרנט כאילו היה תיעוד של הצפות הענק בפלורידה? // שוקי טאוסיג, העין השביעית

שפה שסועה

תרגום מכונה מבוסס בינה מלאכותית מאפשר לנו להיחשף לראשונה לטקסטים באינספור שפות שאנחנו לא דוברים, ולתקשר עם אנשים שאין לנו שפה משותפת איתם. אבל פליטה אפגנית שניסתה לקבל מקלט בארה”ב חוותה את הצד האפל של תרגום המכונה, כפי שנחשף בכתבה של Rest of World.

הפליטה האמורה דוברת פשטו, ובהליך בקשת המקלט נעזרה באומה מירכאיל, מתרגמת-משבר שמתמחה בשפות אפגניות ועובדת עם ארגון Respond Crisis Translation, המסייע בתרגום למהגרים ומבקשי מקלט ברחבי העולם. בשנת 20′ דחה בית משפט אמריקאי את בקשת המקלט של הפליטה, בנימוק שהיא מסרה גירסאות סותרות בבקשה הכתובה ובראיונות. בנוגע לאירוע מסויים, הפליטה סיפרה בראיונות שעברה אותו לבדה, אולם בהצהרה הכתובה סיפרה שהיו איתה אנשים נוספים באותו זמן.

המתרגמת מירכאיל בדקה את המסמכים וגילתה שהצהרת האישה תורגמה בתרגום מכונה, שהפך את כינויי הגוף מ”אני” ל”אנחנו”.

ההקשר הפוליטי של הסיפור הזה הוא הגידול במספר העקורים האפגנים, שהתגבר עם הנסיגה האמריקאית מאפגניסטן וחזרת הטליבאן לשלטון. ב-2021 היו יותר מ-6 מיליון עקורים אפגנים, לפי הערכת נציבות הפליטים של האו”ם (UNHCR). עשרות מיליוני אפגנים, ובהם הפליטים, דוברים דארי או פשטו, שתי השפות הרשמיות במדינה, ורבים מהם אינם דוברים אנגלית או שפות אחרות, לכן הם נדרשים לשירותי תרגום להתנהל מול הרשויות במדינות היעד. הביקוש המוגבר יוצר מחסור במתרגמים – תרג’ימלי, מלכ”ר שמחבר בין פליטים ומבקשי מקלט למתרגמים ומתורגמנים מתנדבים, רשם ב-2022 גידול של פי 4 בבקשות לתרגום שפות אפגניות. בהיעדר מתרגמים אנושיים, בתי משפט וארגוני סיוע נאלצים לפנות לתרגום מכונה.

ההקשר הטכנולוגי של הסיפור הוא הדרך שבה בינה מלאכותית לומדת שפות. משתמשי תרגום מכונה יודעים שהוא לא מושלם – אפילו בעבודה על הפוסט הזה קיבלתי מגוגל טרנסלייט תרגום לא מספק – הוא תרגם “pronouns” ל”כינויים” במקום “כינויי גוף”. הסיבה היא שמודלי שפה נבנים באמצעות אימון בינה מלאכותית על טקסטים דיגיטליים מקוונים (או זמינים בדרך אחרת למפתחי הבינה המלאכותית). ככל שקורפוס הטקסט הזמין של השפה גדול יותר, מודל השפה ילמד את השפה טוב יותר. לפשטו ודארי קורפוס טקסט דיגיטלי מקוון זמין קטן יחסית, ולכן תרגום המכונה שלהן לוקה בחסר וזרוע שגיאות. שגיאה קטנה אחת כזאת היוותה תירוץ מספיק לביהמ”ש לפסול את בקשת המקלט.

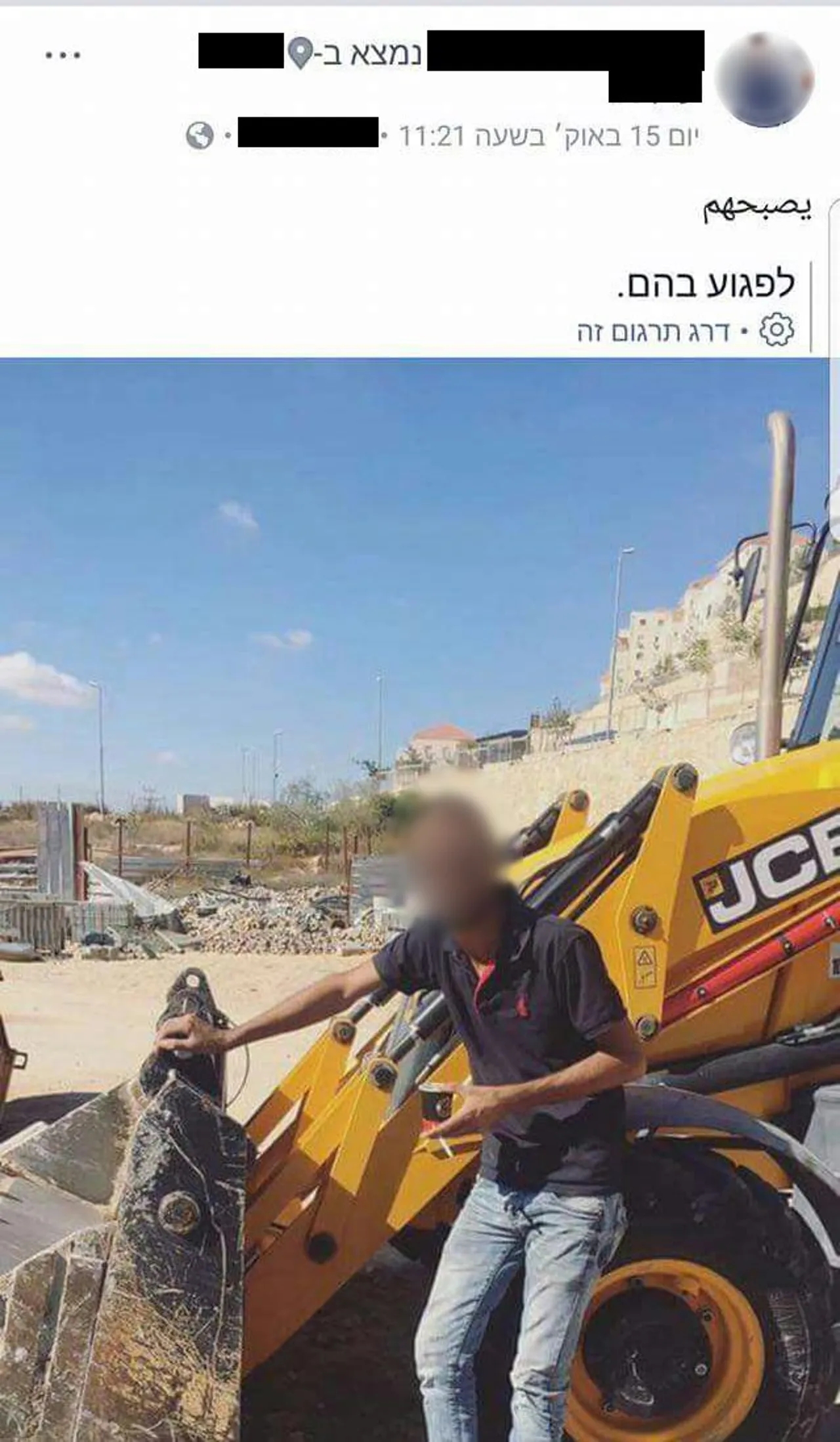

גם אצלנו נפל אדם קורבן לתרגום מכונה שגוי: ב-2017 פרסם פלסטיני בפייסבוק תצלום שלו עם דחפור באתר הבנייה שבו עבד, והכיתוב “يصبحهم” (יסבחהום), שמשמעותו “בוקר טוב להם”. אולם תרגום המכונה של פייסבוק תרגם לעברית “לפגוע בהם” ולאנגלית “hurt them”, משום שזיהה את המילה בטעות כ-يضبحهم (ידבחהום) – הבדל דיאקריטי קריטי. משטרת מחוז ש”י עצרה את האיש בחשד שהוא מתכוון לבצע פיגוע דריסה עם הדחפור, מבלי שווידאה קודם את נכונות התרגום עם דובר ערבית. המשטרה הודתה בתגובה ל”הארץ” כי טעות התרגום הובילה למעצר השווא, וציינה כי “במסגרת החקירה עלה כי אין חשד להסתה והחשוד שוחרר”. פייסבוק מסרו בתגובה לגיזמודו: “למרבה הצער, מערכות התרגום שלנו עשו טעות […] שפירשה לא נכון את מה שהאיש כתב. […] אנחנו מתנצלים בפניו ובפני משפחתו על הטעות ועל ההפרעה שהיא גרמה”. למרות היעדר כוונות רעות, האיש מחק את הפוסט, וסירב להגיב לפניית “הארץ”.

משטרת קופנהגן חקרה ב-2012 אדם בחשד לגיוס כספים למחתרת הכורדית PKK, ואחרי שהתמוטט בחקירה עורך דינו גילה שהראיה שהוטחה בפניו היתה סמס שתורגם שגוי על ידי גוגל טרנסלייט. ב-2017, שוטר בקנזס השתמש בגוגל טרנסלייט לבקש מאדם דובר ספרדית רשות לחפש סמים ברכבו, וזה הסכים בגלל שלא הבין את השאלה – גוגל תרגם “Can I search the car?” ל”¿Puedo buscar el auto?”, שניתן להבין בספרדית כ”האם אני יכול למצוא את הרכב?”. השופט הסכים לבקשת האיש לפסול את הראיות שהושגו (פדף).

תרגומי מכונה עלולים לגרום לתקריות בין-תרבותיות. “הניגר מאחרת”, סימס עמית סיני של במאית התאטרון השחורה אן ג’יימס לאחר שהודיעה שהיא מתעכבת. כינוי הגנאי הגזעני הוא תרגום שגוי של הביטוי הסיני הנייטרלי שבו השתמש האיש, 黑老外 (“היי לאוואי”), שמשמעותו “זר שחור”. בדיקת המגזין That’s Shanghai העלתה שהתוכנה מתרגמת את הביטוי באופן גזעני בעיקר כשהוא מצוות לשם תואר שלילי, כמו “עצלן” ו”גנב”. וויצ’ט הסירה את התרגום הפוגעני ומסרה: “אנחנו מתנצלים מאוד על התרגום הבלתי-ראוי. אחרי שקיבלנו משוב מהמשתמשים, תיקנו את הבעיה מיד”. מקרה חמור יותר התרחש בדרום קוריאה, כשאדם סיני ישב לשתות עם עמיתתו לעבודה ובעלה, שניהם קוריאניים. הוא הפעיל אפליקציית תרגום וכתב להם בסינית שישמח לצאת לבלות עם האישה שוב בעתיד, כשהוא מכנה אותה “ג’יג’י”, שמשמעותו המילולית היא “אחות גדולה”, מילת פנייה מקובלת לאישה. האפליקציה תרגמה את ג’יג’י למילה הקוריאנית “אגאסי”, שמשמעותה אישה צעירה רווקה, אחות צעירה של גבר, או עובדת מין בסצינת חיי הלילה. העלבון הלא-מכוון הפכך לקרב אגרופים בין הקוריאני לסיני, שהסתיים בכך שהסיני רצח את הקוריאני ונידון ל-20 שנות מאסר.

תרגומי מכונה שגויים עלולים גם לגרום למטופלים בבתי חולים לעוגמת נפש ואפילו לסיכון חיים. במחקר שהתפרסם ב-BMJ ב-2014, רופאים תרגמו עשרה ביטויים רפואיים ל-26 שפות. רק 57.7% מהתרגומים היו מדוייקים, ואחד התרגומים השגויים המטרידים היה “Your child has been fitting” (הילד שלך עבר התקף פרכוס), שבתרגום לסוואהילי הפך ל”הילד שלך מת”. מחקר דומה שהתפרסם ב-JAMA Internal Medicine ב-2019 הראה סכנה לפגיעה ב-8% מהתרגומים לסינית ו-2% מהתרגומים לספרדית.

אם אתן רוצות להמשיך להפיק את הפודקאסט שלכן גם בימי הריחוק החברתי, אם אתם רוצים לנצל את הזמן הפנוי להתחיל את הפודקאסט שדחיתם עד עכשיו – דברו איתנו באימייל go@podcasti.co או בטלפון 051-562-6638, או בקרו באתר Podcasti.co לפרטים נוספים

הפינה “האחראי על האינטרנט” משודרת מדי שבת ב-19:30~ בתוכנית “שישבת” בהגשת עידן קוולר בגלצ

תגובות

פרסום תגובה

עליך להתחבר כדי להגיב.